Dr. Mario Camacho Pinto.

Académico de Número

Ideado el concepto de l.A en la década de los años 50 e iniciado a continuación su desarrollo práctico por los ingenieros de computadores, progresivamente se fue llegando a la conclusión (1965) de que es necesario simular los mecanismos cerebrales de estructura y organización si se quiere llegar a imitar la mente humana (1).

En la actualidad se admite por consenso que el esperado progreso de la l.A solo podrá obtenerse cuando la Neurofisiología logre resolver los problemas que han frenado a la Ingeniería Electrónica en su intento de extrapolar lo natural a lo artificial.

Personalmente he venido rastreando este tema del cual me mantuvo por algún tiempo inhibido el espectro del sistema matemático binario creado por el logístico ingeniero inglés George Boole con base en las dos cifras digitales O y 1, hasta cuando la American Association for the Advancement of Science, sección del Medical Science patrocinó y realizó en 1979 un simposio y publicó en 1982 el libro “Artificial Inteligence in Medicine” (2).

Me ha parecido interesante para los lectores de “Medicina” presentarles en forma resumida y documentada el tema l.A y Neurología. De las bases para cimentar su enfoque de actualidad trata este ensayo.

Indagando inquietudes en este sentido en nuestro medio, encontré que hay un inicio de práctica aplicada del sistema de programas de consultores en Medicina, concretamente el de Expertos planeado por la American Medical Association como “Medical Family Guide”, por parte de la Texas Instrumen ts Inc. que ha instalado en su sede de Bogotá una sección que está organizando el programa mencionado de expertos con equipo adecuado compuesto por varios computadores e ingenieros especializados en U.S. en software (3).

Allí obtuvimos una demostración práctica de las labores que está adelantando “Texin” con la colaboración de las Universidades Piloto y Andes que curiosamente no tienen Facultad de Medicina. Están trabajando en varios programas como Cefalea, Dolor Abdominal, Deshidratación y preparando el de Pediatría.

Se nos mostró un “razonamiento” entre computador y usuario pantalla y teclado, en que este no sólo hace preguntas sino que también tiene que dar respuestas binarias sí o no de feed back a las contra preguntas de la máquina para orientación que le permita emitir una conclusión.

Según lo informado en el curso de la sesión, podrían eventualmente extender este programa local hacia la docencia médica y paramédica.

La impresión que obtuvimos fue más que todo la de su utilidad para ayudar al médico a organizar y sistematizar sus conocimientos como método rutinario para llegar a un diagnóstico aproximado, que le permita definir conductas con los resultados de exámenes para clínicos y datos de laboratorio que el mismo computador sugiere tener en cuenta antes de formalizar la decisión terapéutica.

El campo es ilimitado, existen muchos otros programas como el Casnet sobre conocimientos, Caduceus para Medicina Interna, Mycin para Enfermedades Infecciosas, etc. que se han realizado en U.S. y acerca de los cuales se espera el veredicto del tiempo. .

S. Smith y M. Braude( 4), publican en Byte, diciembre de 1985 el trabajo “Estrategias de Manejo de Software” en donde explican que el Experto es un sistema computador diseñado para actuar como consultor en decisiones; que está integrado por una base de conocimientos almacenados en un computador y un programa aplicado a la solución de solicitudes particulares “discutido” con el usuario en una pantalla de preguntas y respuestas. Proporciona conclusiones, sugiere soluciones y si es exigido explica sus líneas .de “pensamiento”.

Este sistema de Expertos es considerado como una rama de la inteligencia artificial aplicable no sólo en Medicina sino en otras disciplinas incluyendo robótica. Su actividad comenzó optimista hasta cuando se advirtió que el experticio humano consiste en algo más que aprenderse un libro; es el criterio ganado en años de observación, ensayo y errores de procedimiento. La programación actual es tan exigente que ha hecho necesaria la formación de “ingenieros de conocimiento”.

Definiciones

La es el estudio de las ideas que habilitan los como putadores para hacer las cosas como las ejecutan los seres inteligentes…. Las metas centrales son las de confeccionar computadores más útiles y entender los principios que hacen la LA. posible (5).

Definición de inteligencia natural “es la capacidad para analizar una situación, para descubrir métodos de solución y finalmente para sintetizar detalles hacia una unidad consistente (meta) “(6). Los psicólogos la definen como el conjunto de habilidades que determinan la ejecución de los tests de inteligencia con los cuales se la mide (7). Sencillamente podemos hablar de capacidad de abstracción o de adaptación (8).

Principios básicos de la LA. Emest Kent (9) en “the brains of Me’1 and Machines” hace énfasis en que su libro trata ante todo sobre la organización del cerebro y cómo su estructura única y características funcionales pueden ser aplicables al desarrollo de sistemas robóticas inteligentes.

“Simplificando paradigmas y observaciones la investigación del hardware (alambrado) y del software (programación) de la inteligencia natural, será suficiente para suministrar ideas que puedan utilizarse en la creación de la inteligencia artificial”, porque aun cuando mucho se ha escrito sobre diferencias y similitudes entre cerebros y computadores, hasta el momento este enorme discurrir no se ha traducido en solución práctica en cuanto a LA. se refiere.

Trae una descripción adecuada del hardware del cerebro para los interesados en explorar nuevas direcciones en computadores electrónicos y sistemas de control, particularmente dirigida a los dedicados al diseño de maquinaria para manejar tareas que corrientemente son dirigidas por cerebros naturales, lo que podría llamarse ciencia de la robótica.

El computador y el cerebro son ambos máquinas poderosas, el primero fuerte en matemáticas de alta velocidad y lógica pero muy pobre en sentido común. Recordemos aquí las dificultades del robot corriente o los limitados resultados en los intentos de estructurar el software para la LA.

Sin embargo esto tiene su explicación en que los diseños empleados han sido muy diferentes a los utilizados por el cerebro natural, lo que se está comenzando a corregir ahora con los nuevos microprocesadores de gran escala de integración que tienen diseños que se asemejan en sus redes paralelas (la) a los humanos, con resultados iníciales exitosos.

La psicología cognocitiva, la fisiológica y la conductista (8) han tenido alguna influencia en los programas de computador que ya están mostrando ciertos aspectos positivos a su vez aprovechados por la ciencia del comportamiento.

Advierte Kent que insinúa pero no está sugiriendo ideas para construir un hardware réplica del cerebro porque no tiene ni el conocimiento ni el hardware, pero afirma que si hay interés en acierto de parte de la ciencia de la robótica le será muy instructivo examinar el único ejemplo de máquina pensante y tratar de identificar los principios operacionales que puedan utilizarse.

Kent aspira a demostrar en términos conceptuales cómo un cerebro trabaja. Agrega que una vez entendidas las funciones del cerebro sus esquemas pueden ser trasladados a conceptos y modus operan di por los expertos en electrónica digital y análoga y en software de computador.

Comenta que “ideas útiles de arquitectura y organización neurofisiológica y no puntos finos de neurofisiología es lo que se necesita”. Algunas posiciones particularmente en áreas de las funciones superiores por fuerza son especulativas: “pero una idea que se le ha ocurrido a un erudito en cerebro puede ser una clave razonable para probar aquella función en un sistema artificial”.

Dice además que sólo ha querido tocar algunos tópicos céntricos de la función cerebral, consciente de que si bien son apropiados para una máquina orgánicamente estructurada podrían no serlo para una forjada en silicón y cobre.

Si decimos que el cerebro es una máquina muy compleja, esta afirmación es rechazada, lo cual es un error de interpretación porque no se quiere decir que únicamente es una máquina, concepto que englobaría el de limitada habilidad, sino que su estructura funcional podría utilizarse en el diseño de una máquina que piense como un ser humano, que pueda atender aspectos de mentalidad y encontrar soluciones a interrogantes que de ahí surjan.

Se alega que mente y cerebro son diferentes, pero esta diferencia se desvanece cuando se considera que si el cerebro es manipulado experimentalmente, todos nuestros procesos mentales, sensaciones y percepciones, sentimientos y emociones, nuestros procesos intelectuales, recuerdos y aún estados de conciencia quedarían manipulados también.

Sin embargo, la arquitectura neuronal del cerebro es muy diferente a aquella de un computador y esto cuenta mucho para una máquina pensante. Es indudable que ambos se han desarrollado por evolución, por supervivencia del más apto, por selección de qué características se eliminan y cuales se conservan (19).

Pero sus diseños difieren porque la naturaleza por una parte y los ingenieros de computador por otra, tienen diferentes miras sobre lo que se entiende por más apto. En esta diferencia hay dos aspectos: los problemas que se le exige resolver a la máquina y el hardware disponible para construirla constituyen el primero.

Los computadores originalmente fueron diseñados para realizar operaciones matemáticas, su resultado lógico es que son hábiles para ese menester y no para otras cosas. (Lea también: Amebiasis: Epidemiología y Tratamiento)

En cambio en los cerebros exitosos se fueron formando genes que han venido pasando de generación en generación y que fueron aquellos que pudieron resolver los grandes problemas; la habilidad para las altas matemáticas nunca pudo haber influido genéticamente en el ancestro humano para determinar un diseño de maravilla y aún hoy nuestros pobres encéfalos quedan agobiados cuando se les exige un rendimiento de esta clase.

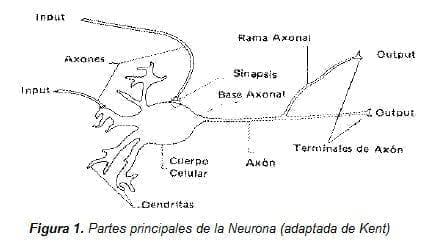

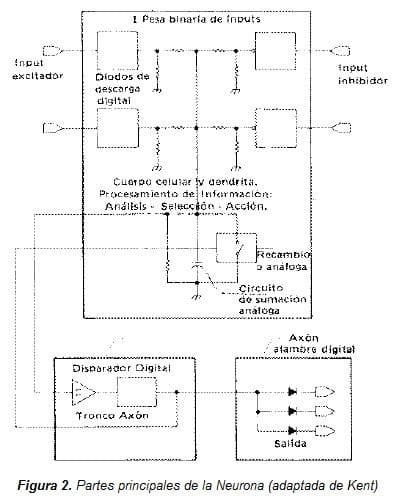

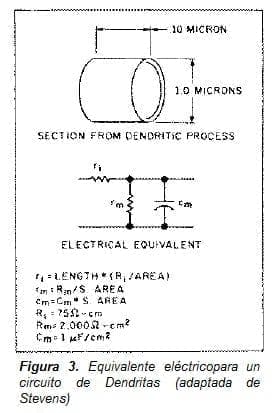

Como es sabido la compuerta lógica del computador y la neurona tienen mucho en común, (ver figuras Nos.2 y 3) pero sus diferencias los distancian.

El cerebro no tiene la velocidad: las neuronas operan en milisegundos y el computador en nanosegundos; pero en cambio sí la cantidad: 14 billones de elementos neuronales. Esta desventaja la han compensado los ingenieros de computador por el reuso iterativo de sus componentes a gran velocidad, porque en cantidad no pueden competir, por dificultad de ensamblaje y costo.

El cerebro usa diseños en paralelos (10) con organización jerárquica y emplea libre y promiscuamente componentes de computación análoga y digital a discreción cuando le son necesarios. Se puede concluir que tanto el cerebro como el computador han encontrado cada uno el diseño más apropiado para dar solución a los problemas que se les ha exigido hasta ahora y al hardware disponible.

Aún cuando los grandes cerebros puedan realizar algunas funciones parecidas a las del computador y este semejantes a las del cerebro, ambos realizan la sustitución pobremente.

Kent señala que coincidencialmente tanto el cerebro como el computador parecen haber sido establecidos en un similar sistema de organización básica sin importar el tamaño; en principio el trabajo del computador tiene el mismo plan básico aunque las máquinas difieren en detalles y volumen (minicomputadores); así mismo el cerebro de la rata de laboratorio tiene el mismo diseño del humano, las mismas partes conectadas en idéntica forma: la diferencia está en la capacidad y en el desarrollo evolutivo de sus partes.

Curiosamente también los cerebros de las diferentes especies pueden ser aún más parecidos entre sí que los diferentes modelos de computadores.

Con la presente configuración de las máquinas computadoras, en cierta clase de problemas que el cerebro resuelve fácilmente su desempeño es “terriblemente ineficiente” y con los prodigiosos programas, la gran cantidad de memorias y toda la admirable velocidad conseguida sólo se obtienen resultados triviales en las actividades que no son de matemáticas y lógica.

Componentes del Computador: (Unidad básica digital) (11). lo. Una o más unidades de entrada. 20. Memoria. 30. Unidad procesadora, (lógica y aritmética). 40. Mecanismo de control. 50. Una o más unidades de salida.

Componentes del Cerebro: Antes de exponer los planteamientos de Kent y de Stevens me parece que en forma sumaria recordemos que en la Neurofisiología convencional de hoy en día se aprende que nuestros órganos sensoriales registran los estímulos provenientes del medio ambiente, conducen esta información a las neuronas que los procesan y almacenan, para transmitirlos en forma inmediata o diferida en forma de impulso excitador determinante de comportamiento mental, emocional, motor, visceral, etc., después de sutiles y complejísimos cambios físicoquímicos en las estructuras neuronales (19).

De tal manera que su conjunto, el cerebro, constituye un biosistema con estructuración, neuroquímica, metabolismo, organización, de cuya interacción surgen propiedades exclusivas como percibir, sentir, recordar, comparar, actuar, etc., que integran la función mental como resultado de actividades emergentes. (22)

Kent ahora en su estilo nos dice que la Neurona es una célula especializada en información procesada equivalen te a una compuerta lógica en una máquina digital o a un amplificador operacional en una análoga, pudiendo desempeñar ambas funciones por separado o simultáneamente porque es muy versátil al tiempo que muy complejo su mecanismo.

John K. Stevens, (12), basado en el estudio de la célula nerviosa de la retina, enseña que esa neurona funciona como un procesador análogo complejo con células de diferentes formas y tamaños de dos categorías: a) procesadoras locales interneuronales; b) de output que comunican a distancia.

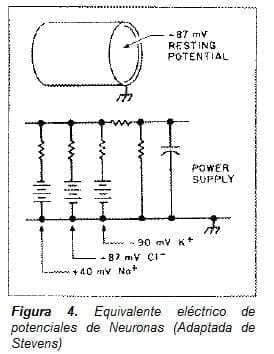

Son unidades de procesamiento lógico con un interior y un exterior cargados de iones cuya diferencia crea un potencial que es modulado por una membrana plasmática de separación provista de bombas iónicas; el líquido exterior es sangre filtrada de concentración regulada por otra bomba en los riñones.

La diferencia iónica intra-extra celular (polarización-despolarización) provee la energía eléctrica en forma similar a una batería cargada por bombas, pero en lugar de usar enchufes de 110 V. emplea glucosa, electrolitos y otros nutrientes. El cuerpo celular o soma contiene la organización genética y metabólica que conocemos para transformar glucosa en ATP (adenosina trifosfato) que activa la síntesis de lípidos y proteínas para mantener membranas, sinapsis, compuertas y citoesqueleto.

Las dendritas de diámetros de un micrón eléctricamente pasivas representan capacitadores y resistencias y su función es la de recibir inputs o concentrarlos a través de las sinapsis; su forma es determinante del tiempo, curso y final del potencial que se inicia en los somas.

Plan general del cerebro aplicable al desarrollo de la inteligencia artificial. La morfología anatómica del cerebro no es muy contributoria en este caso. En cambio las estructuras funcionales sí: se dividen en haces de fibras y núcleos; las primeras constituyen el alambrado del cerebro.

Los segundos constituyen procesadores centrales con una función asignada y un programa de memoria y son, o agrupaciones de células o capas dobladas, formación llamada corteza integrada con elementos locales, de salida y de intercomunicación. Su escalonamiento anatómico corresponde a su jerarquía funcional o de mando y es el resultado de una jerarquía linenaria. (19).

En este momento considero de cierto interés mencionar sintéticamente la interpretación funcional del cerebro, que exponen extensamente Luria y Vigosky, (13). Considera A.R. Luria que el concepto occidental de equipotencialidad del cerebro no es el adecuado.

Escoge como alternativa su concepción interaccionista de zonas del córtex cerebral altamente diferenciadas que trabajan conjuntamente para resolver problemas nuevos mediante nuevas interrelaciones escalonadas y aún jerarquizadas en su organización neurobiológica. Analizando con calma y a fondo el planteamiento conceptual de estos autores moscovitas e idealmente transportándolo a un modelo de LA., resultaría congruente a mi juicio con el que estamos exponiendo.

Sigue Kent diciendo que a cada nivel hay elementos de procesamiento relativamente independiente que cumplen su propio trabajo en paralelas (10) con intercambio de información, con escalones arriba, abajo y lateralmente de tal manera que resulta insensato preguntar en qué sitio del cerebro es procesada una función importante, porque las diferentes modalidades son manejadas en diferentes sub-sistemas funcionales. Sin embargo en la práctica hay orden y no caos.

De esta organización se desprenden 3 características apropiadas para una máquina que intente tratar con ambiente de mundo real y actuar correctamente que son: 1. Capacidad jerárquica para tomar decisiones; 2. Procesamiento paralelo de input-output data y 3. Función de control y seguridad.

Con respecto a la primera, la mayoría de las decisiones que tienen que tomarse pueden ser manejadas a niveles inferiores sin detrimento del tiempo de los altos niveles que pueden dedicarse a trabajos más complejos. Ya estamos viendo comienzos de la aplicación de este concepto en “terminales inteligentes” y en dos o tres niveles de procesos preliminares de 1/0 aliviando una máquina grande, aun cuando esta clase de operaciones no necesariamente están limitadas a ese tipo de artefactos gigantes.

Por el contrario, con la aparición de microprocesadores económicos será posible tener por ejemplo un procesador destinado a dirigir cada coyuntura de una extremidad de un robot computando continua mente las fuerzas requeridas con base en la posición de los miembros o a la velocidad exigida por los altos niveles y a las fuerzas de resistencia y otros inputs de abajo.

La organización cerebral ha provisto de tales procesadores a cada componente muscular. La segunda característica o procesamiento paralelo del 1/0 posee la velocidad adecuada. Fragmentando las tareas en partes que pueden manejarse simultáneamente, el tiempo requerido no será mayor que el invertido en la ejecución de cada uno de sus componentes.

En cuanto a la solución de los problemas matemáticos y lógicos no es sensato partir los problemas porque el resultado de una operación es necesario para iniciar el próximo; son problemas en serie por naturaleza.

Aquí el cerebro no pudiendo trabajar en paralelos, es terriblemente lento. Las dos tareas que requieren el mayor procesamiento del cerebro: análisis de la información que inunda los órganos de los sentidos y el diseño y ejecución de los movimientos en el espacio, condujeron de por sí al procesamiento paralelo de pequeñas sub-unidades. Y así el cerebro sobrepasa en mucho a los computadores (10).

El ejemplo más típico es del campo visual en que todos los datos son suministrados simultáneamente en la superficie de la retina y el cerebro los succiona todos de una vez para análisis simultáneo, un buen consejo sería el de investigar y estudiar los trucos y recursos de ejecución, la rutina práctica de extracción que el cerebro usa para salvar tiempo.

La tercera característica es la del alto valor de supervivencia de los robots. Es enojoso pero no fatal cuando se le presenta un daño al cerebro, la redundancia inherente a la estructura básica del mismo es valioso auxiliar. Recordemos dos hechos favorables: a) Ha habido un orden evolutivo en el desarrollo de su estructura y b) las funciones mayores tienen actualmente representación en todos los niveles.

En cambio los computadores nunca han incorporado piezas de antiguos modelos; el cerebro conserva la mayor parte de los componentes de las formas ancestrales. Durante la evolución, estructuras más capaces fueron desarrollándose para esas mismas funciones básicas en lugar de eliminar las viejas o duplicar sus atributos; las nuevas estructuras tomaron el control de las antiguas que aprovecharon como sub-procesadores, no turnando sino inhibiendo.

Lo mejor de este sistema natural es que cuando hay un daño en un nivel superior, las unidades primitivas normalmente inhibidas, devienen ahora liberadas. Así el daño no tiende a eliminar funciones vitales, sino que únicamente sufren degradación las adquisiciones más recientes en complejidad y eficiencia dejando activas las más antiguas de la conservación o defensa que así exteriorizan por ejemplos comportamientos agresivos (sin inhibiciones).

En situación contraria de daño en los niveles inferiores los más altos pueden reprogramar utilizando suplencias o funciones vicariantes que con el tiempo se logran estabilizar es admirable cómo la información sensorial remanente puede ser utilizada para computar la pérdida: es la configuración dinámica de los sistemas neuronales integrados que ha hecho posible el desarrollo de la tremenda capacidad adaptativa de los organismos superiores. (19)

Como en el estado actual inmediato de los conocimientos de neurofisiología no es posible dar respuesta definitiva y concreta a la pregunta de dónde una función general de alguna complejidad es realizada en el cerebro, no ha de sorprendernos la afirmación de Kent, -ya que algunas nociones clásicas han sido modificadas- cuando advierte que sus lectores habrán caído en cuenta de que no se ocupa casi de la memoria del cerebro humano en esta revisión general de las funciones cerebrales lo cual justifica diciendo que no tiene idea de dónde está localizada porque se halla en todas partes, incorporada dentro de las estructuras del cerebro en cualquier punto en que se requiere la información almacenada.

Recalca que hoy en día solamente se pueden ofrecer especulaciones sobre la naturaleza física y procesos detallados del almacenamiento mnésico cerebral (18).

Se expresa así: “afortunadamente conocemos una gran cantidad referente a la operancia de la memoria del cerebro como “blackbox” de tal manera que podemos comprender cómo entra en los algoritmos del cerebro y así no necesitamos la descripción detallada de su estructura física natural para utilizar sus principios operacionales”.

En cuanto a los computadores se refiere dice que los chips semiconductores corrientes de memoria utilizados en estos dispositivos electrónicos son inferiores a la memoria del cerebro en términos de capacidad, pero ellos son superiores en velocidad y exactitud y si se lograra en cada elemento procesador de robot asociarlos se conseguiría un resultado maravilloso probablemente.

No hay una sola función de memoria, hay muchas, exclama y define así: “la función mnésica es una habilidad para almacenar memorias de actos y eventos”. Para terminar estas consideraciones de principios básicos y de generalidades sobre mecanismos de inteligencia, un punto de máxima importancia dentro de las características del cerebro es que aprende.

Los computadores también aprenden en un sentido limitado durante la programación y algunos programas pueden también aprender a mejorar su representación con base en la experiencia.

Hay por lo menos dos tipos de aprendizaje práctico: hechos que se han sucedido secuencial e iterativamente en varias oportunidades es posible que lo sigan haciendo de nuevo y si concomitantemente han sido asociados con otros banales, en adelante podrán ser ejecutados sólo con estos últimos en forma anticipada; se constituye entonces la categoría de los reflejos condicionados de Pavlov tan conocidos.

Este tipo de acción, no la capacidad de aprenderla, es empleado en algunos sistemas de memoria de computadores que anticipan la próxima memoria. Se encuentran dos limitaciones: la primera es que la única cosa que puede ser aprendida es la temprana ejecución de la respuesta natural a la 2a. clase de estímulo.

Entonces el repertorio conductual del organismo no se aumenta, solo se hace más eficiente. La otra es que todo lo que se necesita para este tipo de aprendizaje es la contigüidad temporal de los efectos no importando si la anticipación es o no de éxito para mejorar resultados.

El segundo tipo de aprendizaje en que el cerebro se empeña, es el llamado “condicionamiento operante” (14). Se trat.a del tipo de aprendizaje que nos permite expandir nuestro repertorio comportamental y basar tales expansiones en la calidad de los resultados.

Simplemente este tipo de aprendizaje está basado en el principio de que las conductas que preceden inmediatamente una recompensa se ven reforzadas en futuras ocurrencias. (21) Aquí recompensa o premio se refiere bien a un evento placentero, bien a la supresión de uno desagradable. Así las conductas que conducen a buenos resultados tienden a repetirse para fusionarse en un conjunto de secuencias positivas estables, es la psicología conductista de Skinner.

Los cerebros más desarrollados confían en el aprendizaje, los menos desarrollados en las conductas prefijadas, se puede decir que es una ley de la evolución por la cual los últimos se adaptan menos a nuevas situaciones, lo que equivale a decir que no han desarrollado inteligencia.

Por el contrario los mamíferos, y en especial el hombre, se caracterizan por una fuerte confianza en el comportamiento aprendible, de lo cual resulta inclusive desamparo temprano durante la edad infantil, seguida de una enorme flexibilidad comportamental y adaptabilidad por aprendizaje inteligente.

El mayor inconveniente es el desarrollo de un sistema que deba operar siempre en un ambiente generalizado en vez de estar especializado en uno para el cual ha sido pre-programado. El corolario es: Un robot exitoso debe ser capaz de condicionamiento operante de premio y castigo; la emulación en las máquinas será de la mayor importancia a fin de manejarlas en un ambiente generalizado.

Resumiendo esta somera revisión conceptual comparativa entre cerebro natural y cerebro robot (inteligencia artificial) bajo un punto de vista práctico y siguiendo las pautas trazadas por Kent se debe efectuar bajo programa sistemático y metódico el estudio y la investigación a fondo de los siguientes cuatro puntos antes de intentar la consideración de un posible modelo de organización de inteligencia artificial con base en el modelo del cerebro humano: lo.

Mecanismos cerebrales de control de output (coordinación en tiempo, feedback). 20. Mecanismos de percepción sensorial (extracción de características, trucos y desvíos). 30. Mecanismos para realizar conductas dirigidas a conseguir una meta (emoción y motivación). 40. Mecanismos de inteligencia y aprendizaje.

Con un enfoque neurológico me he propuesto desarrollar este trabajo largo, laborioso y arduo de apasionante interés tanto bajo el punto de vista estructural como funcional y comparativo; esto constituirá una segunda parte en preparación.

Por ahora continúa la parte general de previo planteamiento. Hinton (10) comenta que los computadores son muy hábiles para multiplicar largas cifras de números o almacenar millones de hechos arbitrarios, pero marcadamente malos para hacer lo que cualquier niño de 5 años de edad puede hacer. La explicación posible dice, es la de nuestra ignorancia y carencia de explicación de lo que pasa en nuestro cerebro en el proceso de aprendizaje por ejemplo.

Cómo podemos pretender la ideación de un diseño operante para las máquinas” ni fabricar estructuras apropiadas, ni disponer de los procedimientos para lograrlo sin esta clase de conocimientos (20). Otra posible explicación es la de que cerebros y computadores trabajan diferentes: para simular todas las neuronas se requerirían miles de computadores; para simular todas las operaciones aritméticas que hace un Cray tomaría billones de personas. Es fácil especular sobre que el cerebro utiliza diferentes principios de computación pero resulta difícil descubrir cuáles son esos principios.

John K. Stevens (12) plantea así el tema: Podremos desarrollar una más eficiente “sexta generación” de computadores de inteligencia artificial usando circuitos copiados directamente del cerebro, quizás usando nueva arquitectura, nuevo hardware y una completamente nueva lógica.?

La respuesta continúa siendo: probablemente no de inmediato, pero como nuestro conocimiento de los principios utilizados en los procesos neurales evoluciona, es una probabilidad que debe tomarse en serio. Además algunos nuevos diseños digitales en redes paralelas imitan de cerca la arquitectura de conjunto de las neuronas. (10)

Revisemos lo que pudiéramos llamar diseños físicos y eléctricos que las células de la retina usan para procesar la información y después meditemos en cómo los diseños de silicón podrían ser adaptados y cómo podrían ser usados en algunas aplicaciones de procedimiento a altas velocidades.

Aún cuando el harware digital es en extremo impresionante, simular 10 milisegundos que dura el proceso de una simple y sola célula nerviosa de la retina para captar y procesar la información visual se requiere la solución de 500 ecuaciones diferenciales simultáneas no lineares, tomaría varios minutos de procesamiento de un supercomputador Cray.

Recordando que hay por lo menos 10.000.000 de células interactuando en vías complejas, tomaría un mínimun de 100 años del Cray para simular lo que pasa en nuestros ojos muchas veces cada segundo. Cómo hace esta impresionante pieza del cerebro este trabajo? Una célula puede tener muchos inputs y outputs: Los dendríticos son análogos, los axonales son digitales- análogos.

Métodos avanzados de registro consistentes en electrodos sub-micrones colocados individualmente cerca de las células en cerebros vivos y en tejidos de cultivo nos han enseñado cantidades sobre las funciones de hardware y software de las células cerebrales. Permiten registrar potenciales de acción y en muchos casos penetran el soma y registran potenciales unicelulares procedentes de sinapsis que han sido activadas en una dentrita periférica.

Otros métodos miden características físicas, cambios moleculares y metabólicos como la Escanografía de positrones (15) Y propiedades de las neuronas y aún proteínas de la membrana. Pero ha sido difícil incorporar estos parámetros físicos dentro de un diseño operante.

La dificultad mayor ha sido la de crear un exacto modelo físico de una neurona porque esto requiere un conocimiento detallado del área de superficie, longitud, ramales y localización de inputs. Las células son muy pequeñas y tienen muy complejas geometrías tridimensionales y estos parámetros no pueden ser observados con la luz del microscopio electrónico de un micron. El microscopio de “scanning” sí permite ver las células pero tienen que ser removidas de su circuito en el cerebro, así que no pueden ser utilizados para analizar circuitos tridimensionales in tactos.

La solución ha sido la de practicar cortes muy finos y luego con la ayuda de un sistema escanográfica especial reunir las secciones en una reconstrucción tridimensional del original; este procedimiento ya es de rutina.

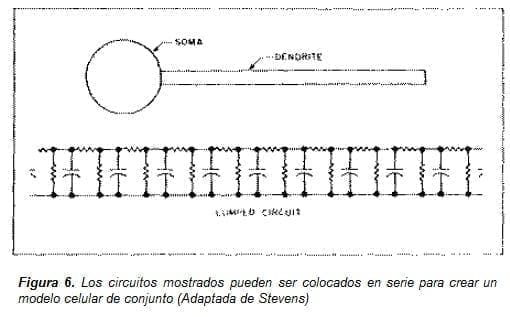

Creación de Circuitos: Para cada uno de los componentes neuronales se idea un circuito eléctrico equivalente que si se combina con la geometría submicronal tridimensional de la célula hará posible crear razonables modelos.

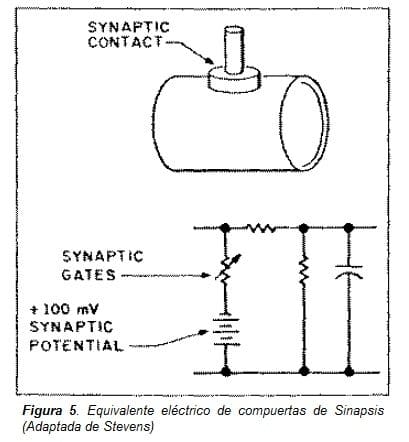

Presentamos en forma gráfica los principios usados por las neuronas para procesar señales, describiendo los equivalentes eléctricos para una dentrita, una fuente de energía y un contacto sináptico (12) Fig. 3-4-5. También se muestra cómo la forma de los apéndices celulares puede alterar los inputs-outputs. Es posible crear así mismo un equivalente eléctrico para el axón.

Circuitos eléctricos de las dendritas: estas tienen un esqueleto que con trola su forma y sus ramales y una membrana fina de fosfolípidos que son aislantes; el interior, contiene un ge 1 o axoplasma conductor. Es decir, una dendrita es un alambre conductor aislado. Los apéndices pueden ser representados eléctricamente como una red escalonada de resistencias pasivas y de capacitadores.

La fuente de energía de una célula puede ser representada por pilas iónicas de K, Na, C1, en serie más una resistencia.

Sinapsis o compuerta de circuito: los ‘inputs sinápticos se simulan por cambios de voltaje controlados en la resistencia de membrana conectada a la pila iónica: puede ser positiva excitatoria o negativa inhibitoria.

Cuando el voltaje intrasinapsial aumente, se librarían los neurotransmisores químicos que selectivamente alterarían la permeabilidad de uno o más iones. Una compuerta típica puede tener 5-0 por 1012 ohms en reposo y 5-0 por 108 en acción. Así que una sinapsis no es tan simple, es más bien un complejo pasivo, una red de “resistencia-capacitada” complicada ¿por un factor biológico?

La geometría de la célula puede ser utilizada para controlar la fuerza como ya vimos.

Circuito eléctrico de la célula amacrina de la retina. La figura 6 muestra una reconstrucción por el computador a partir de una serie de microfotografías electrónicas. Tiene interés por su geometría compleja y porque representa una clásica interneurona que no tiene axón, ni tiene potencial de acción; es un diseño físico que el cerebro usa para controlar funciones lógicas, se piensa.

Será posible adaptar el diseño físico del cerebro esbozado aquí a circuitos basados en silicón? Un interrogante atormentador para Stevens fue el de si sería posible adaptar este simple principio de cambiar una geometría tridimensional a otra de circuitos basados en silicón que pudieran simular circuitos cerebrales.

La respuesta de ahora es sí y con facilidad. Jack Kilby de la Texas Instruments ideó el control de muchos parámetros pasivos de silicón tales como el valor de “resistores” up y down por cambio en el tamaño y la forma del área grabada.

Mientras que las constantes para resistencias son diferentes de las del cerebro, es interesante que los circuitos mostrados en las figuras 3 y 6 usados para simular una interconexión con un chip (pastillas electrónicas de silicio) son exactamente equivalentes.

Las ecuaciones y el software usados para simular la célula nerviosa son casi idénticos a los empleados para simular un circuito integrado (Cl) completo. Estas neuronas de silicio son llamadas “silicrones”. Conceptualmente la forma de la célula es grabada sobre el silicio en el sitio de las conexiones lineares convencionales.

Las compuertas son colocadas en lugares donde los inputs-outputs se supone que están colocados y para los “silicrones” de output se simula un axón con un simple circuito gatillo de Smith de un disparo (1 shot). Infortunadamente el silicrón es una curiosidad de laboratorio por ahora. No se ha encontrado forma sencilla de cambiar o modificar la fuerza de la conexión de un silicrón a otro.

Mientras los investigadores neurofisiólogos no tengan realmente un conocimiento claro de cómo el cerebro modifica sus propios circuitos (el diseño físico del aprendizaje) cualquier solución basada en silicón será “no biológica”.

Se debe decir que pasará un tiempo antes de que podamos obtener un entendimiento completo del más impresionante rasgo de los circuitos neurales: su habilidad para programarse a sí mismos (20). Entre tanto será posible crear muy rápidos diseños tipo neuronal con bien definidas funciones pre-alambradas tales como los actuales procesadores de imagen C.C.D. (charge-coupled device), mientras transcurre ese lapso de tiempo antes de que podamos crear lo que legítimamente podrá llamarse la “sexta generación” del computador, basada en modelos neurológicos.

Reflexiones acerca de un modelo cerebral. Aún para los estudiosos del cerebro que estén de acuerdo en lo que él hace, no es unívoca su interpretación conceptual porque este órgano es tan complejo que ningún modelo experimental podrá lograr algo más que una aproximación que tal vez llegaría hasta el énfasis en aspectos distintos o representarlos en forma diferente de un modelo a otro.

Kent revela que tuvo que escoger entre una riqueza de funciones y tópicos interesantes del cerebro aquellos aspectos que pueden tener ingerencia en los sistemas artificiales. Además confiesa que bien ha podido pasársele por alto algún detalle importante para iluminar un enfoque, o bien estar ignorando resultados recién producidos de nueva tecnología que en el día de mañana puedan mostrar apropiado lo que hoy no parezca.

Es de anotar que hay muchos eslabones faltantes en nuestro conocimiento del cerebro. En algunos casos dice, ha tenido que acudir a enfoques teóricos por falta de evidencia; en otros el modelo es más especulativo que real y en lo complejo se ha visto forzado a simplificar, quizás demasiado, a veces.

El problema mente-cerebro. Dice Kent que en un cierto aspecto esta relación es “insoluble” porque la mente es una experiencia privada, no hay forma de conocer el contenido de la mente ajena y la propia no siempre o incompletamente (conócete a sí mismo).

El hecho de que usemos las mismas palabras para describir una respuesta mental subjetiva ante los mismos estímulos, sólo muestra que hemos aprendido a asociar ciertas palabras con lo que sentimos, sin que esto pruebe la igualdad de la sensación experimentada en los distintos individuos, de ahí la dificultad para poder hablar de la mente en general.

Si tratamos de hablar de la relación entre la mente -que no es una parte del universo físico- y el cerebro que sí lo es, de hecho confrontamos el problema de cómo relacionarlos. Si la mente no es física entonces ¿cómo poder establecer leyes aceptables para el cerebro físico?

Solamente como un acto de fe de nuestra parte -dice Kent- para aceptar que nuestras mentes, cuya experiencia adquirimos por introspección, tienen alguna relación con el cerebro físico o las conductas físicas ante el mundo exterior. Esta hipótesis desde luego no es convincente pues para la mayoría es aceptable que mente y cerebro se in ter-relacionan.

Por consenso se acepta que el estado mental tiene influencia sobre el comportamiento y nadie objeta que el cerebro está involucrado en este proceso aun cuando se discuta sobre cuál tiene el predominio. Si los neurocientíficos tuviesen que explicar el fenómeno del comportamiento fisiológico con base en las funciones físicas del cerebro y sus inputs físicos tendrán que dejar a otros la explicación de las relaciones existentes entre los estados secuenciales de sus experiencias mentales (psicológicos).

La hipótesis de Kent es la siguiente: no hay distinción entre mente y cerebro, y la aparición de dos mundos diferentes, el mental y el físico, refleja solamente dos métodos diferentes de observar el mismo fenómeno.

De acuerdo con esto, aquel evento observado como actividad neuronal de una parte de nuestro cerebro y como nuestra experiencia mental por introspección, representa un solo event? único subyacente sobre el cual nosotros construimos el mundo físico aparente y el mundo mental aparente, de acuerdo con la forma como la hayamos observado.

Podría ser también que el evento subyacente fuera algo distinto con lo cual construiríamos dos mundos aparentes según el aspecto que observáramos. Según Kent su hipótesis unívoca resuelve el problema de correlación, libera de la necesidad de decidir prioridad, se trata de una sola operación 10 que da libertad para establecer sus leyes de gobierno. No se hace necesario indagar causalidad entre los dominios mental o físico.

Se podría argüir en contra de esta hipótesis que bien puede tratarse de dos mundos de experiencia que existen por separado y funcionando independientes a lo cual arguye que sería una complicación gratuita que obligaría a inventar conexiones de paralelismo como relación efectiva ya establecida de por SI.

Se pregunta si la mente regula el cerebro o es el cerebro el que regula la mente. Se responde él mismo diciendo que hay solamente una operación y somos libres para buscar sus leyes sin preocuparnos cómo su desarrollo es realizado para prevalecer en uno u otro.

No hay necesidad de establecer relaciones de causalidad bajo un punto de vista práctico. Del estudio de la función cerebral y especialmente del estudio de los reportes humanos de experiencias subjetivas experimentales (estimulación) atinentes a la manipulación cerebral, se deduce que existe entre la función cerebral y la experiencia mental correspondencia de uno a uno.

La actividad de la corteza visual es siempre relacionada con experiencia visual; la corteza límbica con procesos emocionales y comportamiento con sentimientos subjetivos; activación de patrones comparativos, reportes de decisiones subjetivas que dan la sensación de captar para actuar y se acompañan de actividad motora que produce acción, corresponden al córtex prefrontal.

Al aceptar este postulado surgen muchos asertos de interés e interrogantes que pueden ser planteados, concernientes a esta relación entre cerebro y mente y la relación potencial entre mente y máquinas. Entre otros, el primer interrogante sería el de causalidad: corre ésta desde la mente hacia el cerebro o al contrario. 2o.

El cerebro trabaja porque la mente lo dirige, o experimentamos los fenómenos y cualidades de la mente porque la operancia de la misma mente los genera como un sub-producto? 3o. ¿En este caso qué sería de la libre determinación? 4o. ¿Desaparecería la palabra mérito y otras similares? 5o. ¿Qué de las obras inmortales del ingenio humano debidas a la imaginación y a la creatividad si sólo conociéramos lo que nuestros sentidos nos permitieran captar del mundo exterior?

¿Podrían los sordos escribir música y los ciegos emitir conceptos sobre estética? Estas consideraciones están fuera del lugar neurofisiológico del presente trabajo y no volveré sobre ellas porque entre otras cosas estarían repitiendo lo que escribí hace muchos años en mi tesis de grado, y porque no están comprendidos al menos por ahora en la zona de influencia de la inteligencia artificial.

Si preguntamos qué aspectos de la operancia cerebral son identificados como una experiencia mental peculiar o viceversa y qué propiedades se requieren de una organización material similar a la del cerebro para demostrar facultades como las de la mente, diríamos: la primera pregunta no es difícil de responder porque es fácil señalar buena correspondencia entre experiencia subjetiva (conciencia) y operación cerebral física.

Y sobre la segunda tendría que ser un poco elusiva diciendo que el cerebro es más fácil de entender en términos de “construcciones de experiencia subjetiva” empleados para describir la mente que en términos de construir teorías de comportamiento para describir acciones físicas del organismo. La lógica de estos planteamientos depende de si el cerebro y la mente son en realidad una misma cosa.

Podría ser también que el evento subyacente fuera algo distinto con lo cual construiríamos dos mundos aparentes según el aspecto que observáramos. Según Kent su hipótesis unívoca resuelve el problema de correlación, libera de la necesidad de decidir prioridad, se trata de una sola operación 10 que da libertad para establecer sus leyes de gobierno. No se hace necesario indagar causalidad entre los dominios mental o físico.

Se podría argüir en contra de esta hipótesis que bien puede tratarse de dos mundos de experiencia que existen por separado y funcionando independientes a lo cual arguye que sería una complicación gratuita que obligaría a inventar conexiones de paralelismo como relación efectiva ya establecida de por SI. Se pregunta si la mente regula el cerebro o es el cerebro el que regula la mente.

Se responde él mismo diciendo que hay solamente una operación y somos libres para buscar sus leyes sin preocuparnos cómo su desarrollo es realizado para prevalecer en uno u otro. No hay necesidad de establecer relaciones de causalidad bajo un punto de vista práctico.

Del estudio de la función cerebral y especialmente del estudio de los reportes humanos de experiencias subjetivas experimentales (estimulación) atinentes a la manipulación cerebral, se deduce que existe entre la función cerebral y la experiencia mental correspondencia de uno a uno.

La actividad de la corteza visual es siempre relacionada con experiencia visual; la corteza límbica con procesos emocionales y comportamiento con sentimientos subjetivos; activación de patrones comparativos, reportes de decisiones subjetivas que dan la sensación de captar para actuar y se acompañan de actividad motora que produce acción, corresponden al córtex prefrontal.

Al aceptar este postulado surgen muchos asertos de interés e interrogantes que pueden ser planteados, concernientes a esta relación entre cerebro y mente y la relación potencial entre mente y máquinas. Entre otros, el primer interrogante sería el de causalidad: corre ésta desde la mente hacia el cerebro o al contrario. 2o.

El cerebro trabaja porque la mente lo dirige, o experimentamos los fenómenos y cualidades de la mente porque la operancia de la misma mente los genera como un sub-producto? 3o. ¿En este caso qué sería de la libre determinación? 4o. ¿Desaparecería la palabra mérito y otras similares? 5o. ¿Qué de las obras inmortales del ingenio humano debidas a la imaginación y a la creatividad si sólo conociéramos lo que nuestros sentidos nos permitieran captar del mundo exterior? ¿Podrían los sordos escribir música y los ciegos emitir conceptos sobre estética?

Estas consideraciones están fuera del lugar neurofisiológico del presente trabajo y no volveré sobre ellas porque entre otras cosas estarían repitiendo lo que escribí hace muchos años en mi tesis de grado, y porque no están comprendidos al menos por ahora en la zona de influencia de la inteligencia artificial.

Si preguntamos qué aspectos de la operancia cerebral son identificados como una experiencia mental peculiar o viceversa y qué propiedades se requieren de una organización material similar a la del cerebro para demostrar facultades como las de la mente, diríamos: la primera pregunta no es difícil de responder porque es fácil señalar buena correspondencia entre experiencia subjetiva (conciencia) y operación cerebral física.

Y sobre la segunda tendría que ser un poco elusiva diciendo que el cerebro es más fácil de entender en términos de “construcciones de experiencia subjetiva” empleados para describir la mente que en términos de construir teorías de comportamiento para describir acciones físicas del organismo. La lógica de estos planteamientos depende de si el cerebro y la mente son en realidad una misma cosa.

Conciencia y su contenido. El tópico de la conciencia en el sentido de alertamiento mental puede ser dividido en dos cuestiones. La primera concierne al mecanismo per se, y la segunda al mecanismo que determina el contenido en cualquier tiempo.

El primero puede ir y venir y podemos tenerlo en varios grados de intensidad; atención alerta e intensa y concentración por un extremo; somnolencia, relajación cercana al sueño y estupor por el otro. El contenido: nuestras mentes están llenas de eventos mentales de toda suerte, fácilmente distorsionadas como por ejemplo cuando se altera la neurotransmisión sinapsal.

Algunos de sus elementos sirven de estímulo para cambiar nuestro nivel de conciencia, pero conciencia y fenómeno mental marchan y varían independientemente. La conciencia tiene como requisito el funcionamiento total del encéfalo (corteza y tronco).

La actividad que interfiera seriamente la función cerebral, tal como un traumatismo craneo-cerebral, reducción de 02, irrigación sanguínea insuficiente, iatrogenia psicotropa, etc., aminora la vigilia consciente, pudiendo llevar al coma en forma reversible o irreversible.

El sistema reticular activador proporciona una especie de compuerta habilitadora para el cerebro, como un conjunto controla su operación (17). La operancia del prosencéfalo es el substracto necesario para la conciencia. La S.R.A. ascendente da lugar a dos formas de procesos conscientes: uno “tónico?:’ que es continuo, mantiene el estado; otro fasico, de actividad limitada al estímulo.

El estado sostenido de vigilia parece resultar de la actividad de la corteza para mantener el sistema reticular en expectativa y activo por feedback cerrando un anillo. La actividad del cerebro se mide por el E.E.C. que también mide el efecto alertante de la S.R.A. a grosso modo. Las varias influencias que llegan al cerebro bajo el control regulado por esta S. reticular parecen determinar el contenido de la experiencia consciente.

La actividad de la corteza parece corresponder a un estado mínimo de conciencia subjetiva, es más bien un estado de preparación de los datos que recién entran. Es imposible estar consciente sin atender o pensar en algo. SI yo produzco actividad en un sistema sensorial entonces la experiencia perceptual entra a mi conciencia.

SI se produce actividad en su sistema límbico o rinencefálico (amígdala), usted, experimentara una sensación emocional subjetiva como parte de su estado consciente, y así sucesivamente. El contenido parcial de la conciencia es provisto de varias maneras: estímulos mentales del mundo exterior, estímulos físicos.

Pero mucho es internamente producido y espontáneo, no dependiente de estímulos. Es de señalar el papel de los lóbulos frontales en la dirección de aquellas actividades de los niveles superiores de procesamiento cuyas operaciones constituyen mucho del contenido normal de la conciencia. A los lóbulos frontales clásicamente se les ha señalado la función de integrar, regular y ejecutar la conducta humana. Según Kent esta función directiva constituye la atención.

Del lado del input, los niveles superiores de categorización y abstracción forman parte del contenido en la conciencia; los detalles de acción y aún los objetos que dan lugar a ellos, no necesariamente porque pueden no haber sido almacenados.

En output concientizamos los planes de acción pero no los detalles de ejecución que se desplazan a la corteza motora primaria. Podemos anotar y controlar detalladas secuencias de operaciones pero nunca el proceso de los centros operacionales de las funciones reflejas, la zona que interviene en el análisis de la información la constituirían en el lóbulo frontal la corteza primaria motora, la terciaria, la corteza prefrontal y la orbitaria.

Esta última definiría los rasgos de la personalidad. Parece pues que inputs y outputs en cuanto a conciencia se refiere descansan en mecanismos corticales del prosencéfalo activados por la formación reticular. Hay alguna participación subcortical en experiencias rudimentarias que experimentalmente se han mostrado de menor cuantía. Experiencia consciente de emociones generadas por estimulaciones límbicas requieren mecanismos prefrontales.

La mente del robot. ¿Para cuándo? El mismo Kent comenta que una máquina construida siguiendo las líneas de nuestros computadores actuales sería improbable que pudiera tener experiencia consciente sobre la base de alguna similitud con el cerebro.

Considerado bajo el punto de vista del hardware, clasificaría muy por debajo de nuestra hipotética línea de separación. ¿Puede un programa ser ideado con suficiente complejidad para crear mente en una máquina tal? Claro que existe esa posibilidad pero las dificultades devendrían insuperables en la fabricación.

Cabría preguntar si el comportamiento inteligente sería garantía de mente. Aceptando la unidad cerebro-mente en los organismos biológicos se pensaría que lo que necesitamos los humanos es copiar los mecanismos cerebrales para producir una réplica de la mente.

Es duro aceptar que siendo la naturaleza de la mente carbón, nitrógeno, oxígeno e hidrógeno como opuesto a silicón, cobre y oro, esto pueda ser el determinante de su éxito o fracaso. Parece más probable que en algunos aspectos de la estructura cerebral está la clave, pero cuáles? Complejidad es la más aceptable para los expertos.

Puede ser que la mente signifique una propiedad de autosostenimiento, auto-organización de datos procesados; esta es la posibilidad más probable según los expertos y se habla de “propiedades emergentes”, de “suficiente organización compleja de la materia”.

Kent reflexiona de esta manera ante la afirmación de complejidad. Hay dos formas para que un sistema pueda ser complejo: en espacio como cerebro y computador lo son; y en tiempo como el cerebro lo es. En espacio simplemente quiere decir que tiene un gran número de partes con alta conectividad.

En tiempo quiere decir que sus estados sucesivos pueden ser activamente variados y provienen de estados anteriores en intrincadas leyes. Comparado con el cerebro, el computador de hoy en día no tiene problema en espacio pero sí en grado sumo en tiempo.

Si aceptáramos la complejidad como una fuente de mentalidad entonces la complejidad en tiempo sería la clave de sí o no podremos programar una máquina que tenga mente. Si por un momento ponemos atención a la subjetiva experiencia de conciencia, notamos que casi todas las cosas que conforman el contenido de la conciencia son procesos en tiempo dentro del cerebro.

Es difícil concebir cómo sería una conciencia estática. La naturaleza de nuestra experiencia mental está ligada profundamente con la ocurrencia de un proceso en marcha. Pensamiento, sensaciones, planes o acciones, todos son procesos en tiempo.

Probablemente es seguro concluir que el contenido de la conciencia no es determinado por un sencillo estado estático del córtex cerebral, sino por nuestra subjetiva apreciación en tiempo del patrón temporal de reorganización de los estados de los componentes del prosencéfalo.

“Entonces un pensamiento sería una secuencia temporal de los eventos espacialmente ordenados en el cerebro”. Sin embargo el contenido de la conciencia no es toda la mente como ya lo vimos; porque hay además el estado de alerta en el trasfondo. Ese estado de trasfondo o background, la sustancia de que la mente es formada. puede requerir complejidad en el espacio.

Y si hipotéticamente pudiéramos eliminar el contenido de conciencia obtendríamos una mente completamente vacía, de estado de alerta temporal pero estable, quizás similar al de un estado de éxtasis o de meditación.

Tal estado básico, indiferenciado de alerta no descansaría o reposaría sobre procesos temporalmente organizados, podría más bien ser identificado como un estado estático básico preparado para recibir datos procesados suministrables al córtex pertinente por activación reticular.

Si esto fuese así, es difícil entrever cómo ese estado de trasfondo, sustancia de la mente, pudo ser realizado en un exclusivo sistema complejo de tiempo. Hay más, en nuestra experiencia consiente estamos simultáneamente alerta momento a momento del estado de muchos otros componentes de nuestra experiencia consciente total.

La dirección proporcionada por la apreciación de su secuencia temporal es un importante componente de la mente, pero también lo es la habilidad para apreciar las relaciones simultáneas de las partes. Quizás podamos programar una máquina para codificar las relaciones temporales contenidas en esta experiencia de simultaneidad y quizás podamos tener una conciencia secuencial en la cual el estado de alerta de background fuese organizado por un código de simultaneidad.

Más si esto se lograra posiblemente sería una especie muy diferente de conciencia de la que conocemos. Kent sospecha entonces que una complejidad espacial es necesaria para la sustancia de la mente, mientras que la complejidad temporal puede bastar para el contenido o forma de la mente. Si removiéramos partes del prosencéfalo, no eliminaríamos mucho de la conciencia, eso sí empobreceríamos su contenido progresivamente.

En un computador los registros del procesador central pueden considerarse como similares a los procesos de auto-organización simultánea en un cerebro restringido y obviamente si removiéramos una parte, el contenido de la conciencia en una máquina sería anulado completamente hasta perder su nombre.

Kent anticipa que una máquina tipo de computador que sea capaz de contener el temporal contenido de la mente y de imitarla en su conducta, no podrá en ningún grado adquirir la sustancia y esencia de la mente necesaria para la apreciación de aquel contenido en el sentido en que nosotros lo hacemos.

Todas estas lucubraciones están condicionadas a que se lleguen a demostrar previamente las siguientes suposiciones: 1. Identidad mente-cerebro. 2. Separación de sustancia v forma en la mente. 3. Necesidad de complejidad para esa mente a nuestro nivel. Infortunadamente en principio estas suposiciones no podrán ser probadas ni experimental ni clínicamente, ni chequeadas en pruebas al menos por ahora.

Si nosotros queremos ocuparnos y especular sobre máquinas que parezcan inteligentes y consientes necesitamos hipótesis operantes; miremos hacia las ideas de los demás, escuchemos a los que tengan la oportunidad de observar y experimentar, de actuar en condiciones propicias, de disponer de los elementos apropiados para adelantar esta nebulosa tarea.

Si los computadores a cualquier nivelo los robots se comportan en la forma que nosotros esperamos comportarnos en idénticas situaciones y tenemos razón para sospechar que sus principios operacionales copian los nuestros en una forma aproximada y aceptable, entonces podremos creer que ellos tienen mente.

Sin embargo estas concesiones hipotéticas son eminentemente cuestionables no por la idea en sí, sino por miedo que inspira un posible resultado adverso como el de una diferente clase de conciencia peculiarmente si esta es poderosa. Necesitamos diseñar máquinas que solamente tengan como metas primarias su total acuerdo con las nuestras para esperar de ellas que sean nuestros aliados y nunca nuestros enemigos.

Hay algunas cosas que parecen definidas: la posibilidad de que podamos encontrar una variedad de aplicaciones para las máquinas que tengan capacidades parecidas a las del cerebro; la probabilidad de que se puedan emplear las estructuras actuales y las funciones del cerebro como un modelo reproducible a voluntad, al menos en algunos aspectos.

Hay otras que no lo están, como la posibilidad de que puedan tener una experiencia consciente subjetiva como la nuestra. (21)

Conclusión

En mi concepto uno de los cambios científicos más interesantes de las últimas décadas es el aclaramiento de las relaciones de orden dentro de las diversas partes del mundo real definidas como Sistemas y conformadas por acumulación de “materia-energía”, pues ha permitido descubrir características compartidas antiguamente negadas. Un ejemplo es la relación entre ciencias biológicas y ciencias físicas, cuyo legendario distanciamiento nos legó el dilema “mente-materia” , enfermedad mental-enfermedad física.

La teoría general de sistemas ofrece una solución a esta discutida dicotomía entre mente y materia, pues se sostiene que existe sólo entre “materia-energía e información”. En la ciencia de los computadores no existe dicotomía pues las señales llevan la información.

El cerebro es considerado como un sistema que puede organizar la información que recibe en un modelo multidimensional elaborado del mundo exterior y utilizar este modelo para llegar a decisiones inteligentes.

Al computador no se le ha dado este modelo con el cual se le dotará en el futuro según los expertos lo que le dará una comprensión global de que actualmente carece. Así se lograría el desarrollo de una inteligencia verdaderamente artificial que pudiera ser aplicada apropiadamente a procesos de tan alta categoría mental como el diagnóstico médico.

Bibliografía

1 Douglas B. Lenal. Computer Software for Intelligent Systems. Byte. Pag 204 1985.

2. Peter Szolovitz. Artificial Intelligent in Medicine. A.A.A.s. Symposio 1982.

3 Julio Lopez. Expertos. Texins, Bogota. Informacion personal 1986

4 S. Smith y M. Brande. Soflware Mangement Strategies. Gartner Group Pag. 3. 1985.

5 P.W. Winston. Artificial intelligence 1977.

6 Harvcy S. Levin, Arthur Benton Baker Clinical Neurology. 1-11-14. 1984.

7 Graham Beaumont. Introduction to Neuropsychology. Blackwell . ScPress 1983

8 K. Heitman. E. Valenstein. Clinical Neuropsychology.Oxford 1979

9 Ernest Kent The Brains of men and Machines. Me. Graw.198I

10 Geoffrey Hinton. Learning in Parallet Neworks. Bytc. A.I. pag 265. 1985.

11 John Murphy. Curso Basico de Computadores Digitales. Ed. Glem. B. Aires. 1973.

12 .Johns Stevens Reverse Inginecring the Brain. Byle. IV 1985.

13 A.R.. Luna I unciones Corlicales Superiores del Hombre. Ed. Orbe La Habana. 1977

14 Artbur Bachraih. T del Aprendizaje. A.M. Freedman Psiquiatría. II. Salvat 1982.

15 Gonzalez Vicente. Symposio Sociedad Neurologica de Colombia 1985

16 Jack Kilby. Texas Inst. lnc. Citado por Stevens. 1985

17 H.W. Magoun. The Waling Brain. Ch Thomas 1960.

18 A.R. Luria. Neuropsicologia de la Memoria. II: Blune Ed. 19XO.

19 S. Kffer y .J. Nicholls From Neuron to Brain. Sinacer Inc. Mass. Pag 405. 1977

20 Tom Alexander Ehy Computers Can’l Outhink ibe Experts Tecmology. Byte X. 1984.

21 B.I• Skaner Science and Human Bchavior Free Press N. York. Pag 59 y sg 1965.

22 David Olloson Phisiology of the Nervons System Karolinsk Institute. 1983.

23 Charles M. Eair the Physical Foundations of the Psyche. Pag. 97 y mg 1963